AI dwingt de verborgen kosten onder ogen te zien van het niet goed beheren van gegevens

Dit artikel is origineel geschreven in het Engels. Ik heb de tekst laten vertalen naar het Nederlands met Microsoft Copilot en heb daarin minimale aanpassingen gemaakt. Het is daarmee niet mijn “stem” zoals ik zelf artikelen schrijf. De originele tekst is te lezen als je op het engelstalige vlaggetje klikt in het menu bovenaan de pagina.

Datamanagement staat op de agenda doordat de opkomst van AI de noodzaak ervan onmiskenbaar heeft blootgelegd. Organisaties constateren dat hun huidige datamanagementpraktijken ontoereikend zijn om de transitie naar door AI aangestuurde bedrijfsprocessen te realiseren.

De boodschap dat goed datamanagement essentieel is, is niet nieuw. Deze is in het verleden herhaaldelijk verkondigd. Wat echter wél nieuw is, is dat er ditmaal geen technologische oplossingen worden gepresenteerd die een ‘silver bullet’ oplossing suggereren. De nadruk ligt op de menselijke verantwoordelijkheid voor data governance. Dat is een belangrijke stap vooruit.

Desondanks blijven bestaande gewoontes hardnekkig. Dit opiniestuk richt zich op wat naar mijn overtuiging een structurele blinde vlek vormt voor degenen die binnen hun organisatie verantwoordelijk zijn voor datagovernance.

De kern van mijn betoog is dat de primaire aandacht zou moeten uitgaan naar de systemen voor vastlegging (systems of record).

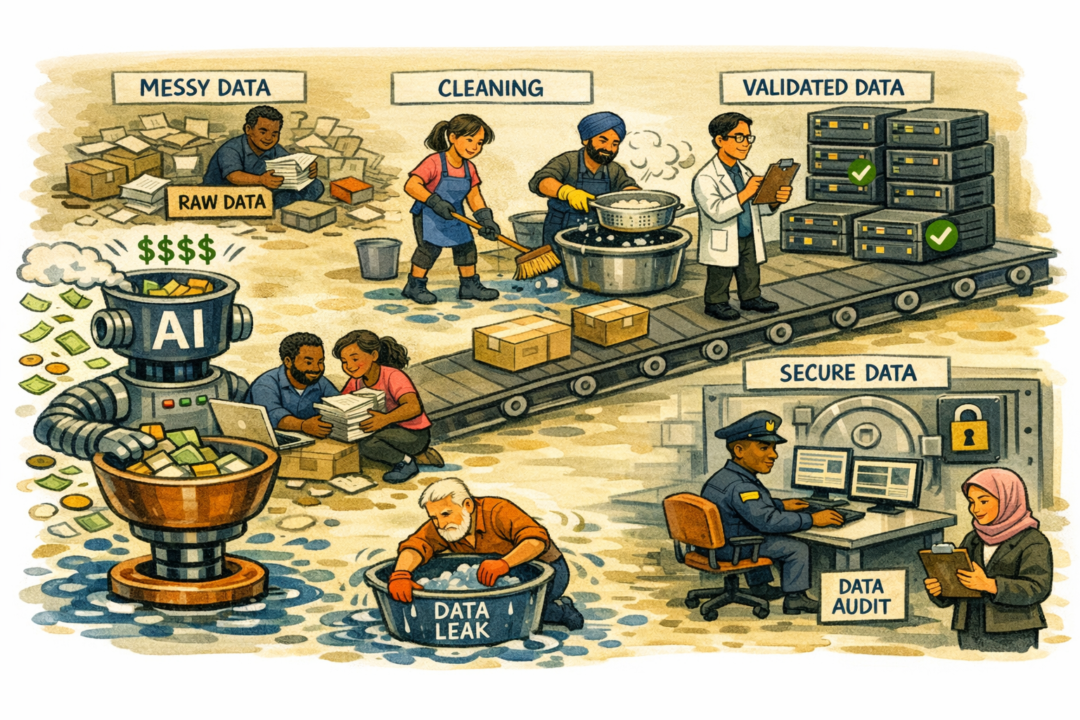

De verborgen kosten van huidige oplossingen voor dataproblemen

Data is optimaal inzetbaar voor AI-toepassingen indien data correct wordt vastgelegd en onderhouden. Maar wat is ‘correct’? Het houdt in dat de data het onderliggende (business)event nauwkeurig representeert, dat gebruikers de betekenis van de data begrijpen en dat geautomatiseerde processen die op deze data steunen binnen de gestelde grenzen functioneren.

Wanneer data niet correct wordt onderhouden ontstaan, vaak verborgen, kosten:

- Er is inspanning nodig om processen (menselijk of geautomatiseerd) te herstellen wanneer deze door foutieve data buiten de grenzen raken, met mogelijk financiële schade tot gevolg.

- Er moet worden onderzocht waarom het proces buiten de grenzen is geraakt.

- Er worden vergaderingen georganiseerd om te bepalen welke maatregelen nodig zijn om het probleem op te lossen en herhaling te voorkomen.

- Er moet tijd worden besteed aan herstel.

- Er moet tijd worden besteed aan preventie.

Tot zover is dit herkenbaar als een PDCA-cyclus. De fase ‘preventie’ is echter waar het problematisch wordt.

In de praktijk gebeurt namelijk vaak het volgende, in plaats van het registrerende proces zelf te verbeteren:

- Er worden secundaire systemen en datakwaliteitsprocessen ontwikkeld om afwijkingen te signaleren.

- Deze kwaliteitsprocessen worden gedefinieerd, gebouwd en onderhouden, vaak binnen een losstaande data-afdeling.

- Teams komen periodiek bijeen om de uitkomsten van deze kwaliteitsprocessen te monitoren en te duiden.

- Er wordt veel tijd besteed aan het creëren van gedeeld begrip: waarom is de data buiten de grenzen geraakt, wat betekent dit, en wat zijn de gevolgen?

- Governanceprocessen worden ingericht om ervoor te zorgen dat de juiste personen actie ondernemen op de bevindingen, omdat de verantwoordelijken voor kwaliteitsmonitoring niet dezelfde zijn als degenen die het registrerende proces beheren.

Dit zou al zorgwekkend zijn wanneer het één dataset betreft, maar in werkelijkheid speelt dit bij talloze datasets binnen een organisatie, die later worden geïntegreerd in bedrijfsprocessen of ketens.

De impact van deze werkwijzen op AI-adoptie

Wanneer AI wordt ingezet op data die via deze meerlagige PDCA-structuur wordt beheerd, en wanneer AI bovendien end-to-end bedrijfsprocessen moet ondersteunen, ontstaan aanzienlijke extra kosten.

Het onderhouden van meerdere versies van dezelfde data — elk met een eigen kwaliteitsniveau — leidt tot substantiële overhead. Daarnaast zijn aanvullende governance- en toezichtmechanismen nodig om AI-uitkomsten te controleren, juist omdat de onderliggende datamanagementprocessen versnipperd zijn.

Zwakke datafundamenten zorgen voor exponentieel toenemende kosten in datamanagement, het is een sneeuwbaleffect. De vraag is dan: wat is de oplossing?

In de kern aanpakken

De organisaties die succesvol zullen zijn, zijn degenen die grip krijgen op data op het moment van vastlegging: gevalideerd, ondubbelzinnig, volledig en geschikt voor hun beoogde doel. Dat is de eerste stap en die is al ingrijpend.

Het vereist het herontwerpen van vrijwel alle bedrijfsprocessen en het opnieuw implementeren van systemen van registratie. Pijnlijk.

Maar zelfs dat is onvoldoende. Wie deze uitdaging serieus wil aangaan, moet bedrijfsprocessen organiseren langs de datapaden. De huidige inrichting, gebaseerd op hiërarchische, functionele silo’s, is een overblijfsel van de industriële revolutie en haar focus op taakoptimalisatie.

Datapaden doorkruisen deze silo’s. Wat nu een losstaand of ondersteunend datateam is, wordt in het AI-tijdperk een integraal onderdeel van het primaire bedrijfsproces. Datamanagement wordt daarmee een regulier onderdeel van het business team.

Slechts weinig organisaties handelen hiernaar. Deels vanwege schaarste aan datamanagementexpertise. Deels omdat bestaande structuren en zekerheden diep verankerd zijn. De hiërarchisch-functionele organisatievorm heeft ons decennialang gediend en veel mensen hebben hun loopbaan gebouwd op functies die binnen dat model noodzakelijk zijn.

Door de jaren heen zijn diverse pogingen gedaan om datagovernance binnen deze hiërarchie te reorganiseren: het Information Model van de jaren 70, de datawarehouses van de jaren 80 en 90, het Semantic Web, de Big Data-periode en recent Data Mesh (zoals oorspronkelijk beschreven, niet de technologie gedreven interpretaties die het concept hebben vertroebeld). Al deze initiatieven zijn uiteindelijk tekortgeschoten en zullen dat blijven doen zolang de organisatievorm niet aangepast wordt.

Hoewel ik niet meega in hypes, is het voor mij evident dat organisatie langs datapaden een noodzakelijke voorwaarde is voor succesvolle AI-adoptie.

AI kan pas achteraf worden bestempeld als een nieuwe industriële revolutie wanneer zij organisaties en supply-chain ketens dwingt te herstructureren, doordat de kosten van het voortzetten van traditionele werkwijzen te hoog worden om concurrerend te blijven. Uiteindelijk is het een economische kwestie. De tijd zal het uitwijzen.